Этот кадр программа распознала как "Человек ест хот-дог в толпе".

Американский программист Кайл МакДональд (Kyle McDonald) описал кадры прогулки по Амстердаму при помощи нейросети, разработанной исследователями из Стэнфордского университета. Кратко об эксперименте рассказывает The Verge.

Взяв в качестве аппаратной платформы MacBook Pro 2013 года, разработчик запустил на нем программу обработки видеопотока с веб-камеры и вышел на прогулку по Амстердаму, держа перед собой раскрытый ноутбук. Получившиеся в результате видео с комментариями нейросети автор опубликовал на Vimeo.

Для обработки кадров программист использовал программу NeuralTalk, которая способна описывать происходящее на статичных фотографиях связными предложениями. Алгоритм сначала распознает объекты на статичном изображении, а затем описывает естественным языком их взаимоотношение на картинке. Для изначальной тренировки нейросети использовался набор из 150 тысяч снимков, описанных вручную живыми людьми.

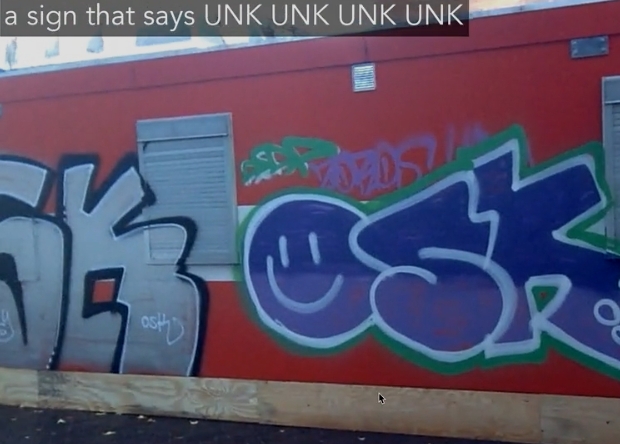

"Надпись, которая гласит UNK UNK UNK"

"Черно-белая фотография поезда на путях"

"Куча припаркованных друг к другу велосипедов"

Ранее международная группа ученых выяснила, что искусственный интеллект разработки Массачусетского технологического института способен пройти тест на IQ на уровне, соответствующем средним показателям четырехлетнего ребенка.

Николай Воронцов

P.S. Программист вышел на прогулку по Амстердаму вместе с нейросетью. Причём в буквальном смысле. Нёс перед собой открытый ноутбук, а программа описывала связными предложениями то, что видит через веб-камеру. Не всегда правильно, но тем не менее.

Исходники в открытом доступе на GitHub лежат, да.