Сразу же после объявления о слиянии AMD и ATI появились первые слухи о разработке комбинированного продукта, который должен объединить центральный и графический процессоры. Вскоре эти слухи подтвердились, когда AMD представила технологию Fusion.

Сразу же после объявления о слиянии AMD и ATI появились первые слухи о разработке комбинированного продукта, который должен объединить центральный и графический процессоры. Вскоре эти слухи подтвердились. С одной стороны, идея совмещения центрального и графического процессоров на одном кристалле кремния может показаться новой, но компьютерная промышленность уже двигалась в этом направлении несколько лет назад. В 1999 году мы сообщали, что такими разработками занималась компания Sun.

Тогда Sun заявляла о работе над технологией совмещения нескольких процессорных ядер и графического ядра в одном корпусе. С другой стороны, говорить, что AMD со своей технологией Fusion двигается не в новом направлении тоже ошибочно.

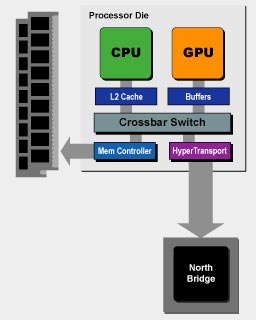

На иллюстрации диаграмма, отображающая основную информацию, известную о технологии Fusion:

Если на этой диаграмме заменить слова GPU на CPU и Buffers на L2 cache, мы получим блочную диаграмму процессора Athlon64 x2. Другими словами, можно сделать вывод, что Fusion в этой интерпретации можно рассматривать как замену одного процессорного ядра ядром графического процессора.

Для первых партий подобных продуктов, эта конфигурация будет вполне естественной. Новая технология найдет свое место в мобильных решениях, а именно, там где нужно экономить место и не нужна очень высокая производительность.

Стоит отметить и разделение видеовыходов, при котором некоторые функции управления монитором останутся за северным мостом. Такое разделение видеофункциональности будет очень похожим на то, что делает Nvidia в своей платформе G80, в которой предусмотрен отдельный чип для работы с DVI интерфейсом.

Зачем это нужно

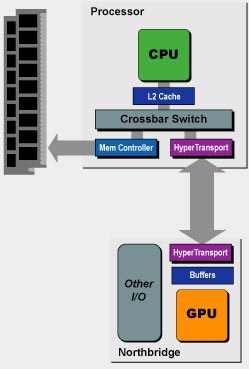

Возможно, у вас возникнет вопрос, зачем же интегрировать функции графического процессора в центральный, а не поместить его, например, в северный мост чипсета? Для мобильных компьютеров на базе процессоров AMD перенос интегрированного графического ядра из северного моста в процессор обеспечит улучшение соотношения производительности на Ватт потребляемой энергии, так как графическое ядро сможет получать доступ к памяти напрямую, ведь оно будет находиться в составе центрального процессора вместе с контроллером памяти. При этом производительность встроенной графики существенно увеличится.

Обратите внимание, что в чипсетах Интел с интегрированной графикой контроллер памяти и встроенное графическое ядро тоже входят в состав одной микросхемы. Оба названных компонента находятся в хабе контроллера памяти (MCH, раньше - северный мост), так что, Интел сильно не выиграет, если тоже перенесет графическое ядро в процессор. Либо Интел нужно поступить точно так же, как AMD, перенося в центральный процессор и графическое ядро и контроллер памяти, либо пойти каким-то другим путем. В последнем случае мы имеем шанс увидеть другое решение, кардинально отличное от того, что делает AMD.

Реального улучшения производительности от интеграции графического и центрального процессоров можно ожидать, когда производители перейдут от простой модульной структуры, рассмотренной здесь. Пока лучшей идеей в этой области можно считать решения, предлагаемые процессорами Cell. Можно представить, что более интегрированным и производительным будет множество потоковых процессоров SIMD (т.н. унифицированных пиксельных и вершинных конвейеров), которые разделяют шину с обычным процессорным ядром, наподобие того, как Cell SPU разделяют шину с PPC ядром.

Чтобы поддерживать интеграцию на таком же модульном уровне сложности, AMD уже сообщила о необходимости добавления графического расширения в систему команд x86 ISA. Это расширение, возможно, и стало одной из причин объявления компанией инициативы "close to metal" (CTM). Представляя в рамках этой инициативы железо графических процессоров ATI кодировщикам, AMD может убить двух зайцев. Во-первых, они могут использовать ISA на низком уровне, создавая базу специфического кода, что сделает это стандартом де-факто. Во-вторых, они могут быстро получить обратную реакцию от индустрии, достаточно точно описывающую то, что реально нужно кодировщикам в графической спецификации ISA.

Оба этих шага прокладывают путь к появлению GPU-специфичных расширений для x86 ISA, создание которых для существующей аппаратной базы ATI было бы большой проблемой. Эти расширения появятся как базовый набор инструкций, призванный синхронизировать работу процессорного и графического ядер и разделение их друг от друга, так как они будут использовать общие шины и контроллер памяти. Более поздние расширения могут превратить x86 в новую архитектуру с развитым набором команд GPU ISA. В конце концов может повториться то, что мы уже видели с x86-64, когда AMD самостоятельно предлагала основные расширения для x86 ISA, а Интел пришлось их использовать.